Araştırmacılar, biyolojik nöronlar tarafından üretilen sivri uçlarınkiyle karşılaştırılabilir geometrilere sahip elektrik darbelerini entegre ederek enerji açısından verimli sinir ağı türlerini eğitme becerilerini geliştirmeyi başardılar.

Geçtiğimiz on yıl içinde yapay sinir ağları (YSA’lar), proteinlerin yapısını tahmin etme becerisi nedeniyle Nobel Ödülü’ne layık görülen AlphaFold modeli de dahil olmak üzere bir dizi dikkate değer aracın geliştirilmesinden sorumlu olmuştur.

Öte yandan bu başarı, hem ekonomik hem de çevresel açıdan giderek artan bir dizi maliyetle birlikte geliyor: Bu tür modellerin makine öğrenimi görevlerinde eğitilmesi için gereken muazzam hacimlerdeki veriyi işlemek için şaşırtıcı miktarda enerji gerekmektedir. Genellikle yapay sinir ağları (YSA) olarak bilinen makine öğrenimi algoritmaları, biyolojik muadillerinden ilham alan hesaplama algoritmalarıdır.

Yapay ve biyolojik sinir ağları arasında belirli benzerlikler olmasına rağmen, biyolojik sinir ağlarının enerji bütçesi yapay sinir ağlarınınkinden (YSA’lar) önemli ölçüde daha düşüktür. Sırları nedir? Genellikle sivri uçlar olarak bilinen kısa elektrik darbeleri kullanılarak bilgi bir nörondan diğerine iletilir.

Bilgi işlemenin seyrek elektriksel darbe örüntüleri aracılığıyla gerçekleşmesinden kaynaklanan olağanüstü enerji verimliliği bunun doğrudan bir sonucudur. Ancak beklenmedik bir şekilde, benzer özellikler henüz ana akım olarak kabul edilen YSA’lara entegre edilmemiştir. Spike’ların süreksiz karakteri, sinir ağlarını eğitmek için kullanılan tipik yöntemlerin uygulanmasını zorlaştıran sorunlara sahiptir. Araştırmacılar onlarca yıldır spiking sinir ağları (SNN’ler) üzerinde çalışmaktadır, ancak spike’ların süreksiz doğası zorluklara yol açmaktadır.

Almanya’daki Bonn Üniversitesi’nden Christian Klos ve Raoul-Martin Memmesheimer, yakın tarihli bir makalede bu zorluğa şaşırtıcı derecede basit bir çözüm sunuyor. Bu yaklaşım, biyolojik nöronların sivri uçları üretme mekanizmasına ilişkin daha derinlemesine bir araştırmadan alınmıştır. Tanımlanan yöntem, SNN’lerin gücünü önemli ölçüde artırma potansiyeline sahiptir ve bu da fizik, sinirbilim ve makine öğrenimi alanlarında çok çeşitli uygulamalara kapı açabilir.

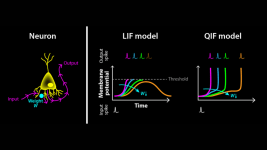

“Sızdıran bütünleştirme ve ateşleme” (LIF) modeli, biyolojik nöronları tanımlamak amacıyla yaygın kabul görmüş bir modeldir. LIF modeli biyolojik nöronların bir dizi önemli özelliğini içerir, kısa sürede simüle edilebilir ve daha karmaşık biyolojik özellikleri içerecek şekilde kolayca genişletilebilir. SNN’lerin makine öğrenimi görevlerinde nasıl performans gösterdiğini analiz etmek söz konusu olduğunda, LIF modelinin varyasyonları standart olarak yaygın bir kabul görmüştür. Dahası, bu paradigma, düşük güçte çalışmayı sağlamak için mimarileri beyinden sonra modellenen bilgisayar çipleri olan nöromorfik donanım sistemlerinin çoğunda mevcuttur.

Biyoloji alanında nöronların aktivitesini açıklamak için kullanılan en önemli faktörler arasında, hücre zarı boyunca var olan ve zar potansiyeli olarak adlandırılan elektrik potansiyeli farkı yer almaktadır. LIF modeline göre bu, bir direnç vasıtasıyla yüklenen bir kondansatör ile örneklendirilir. İyon kanalları hücre zarı içinde bulunur ve direnç bu kanalların bir temsilidir. Bu kanallar yüklü parçacıkların nörona girmesine ve çıkmasına izin verir. Kondansatör, diğer nöronlardan gelen giriş sivri uçları tarafından yönlendirilen akımlar tarafından şarj edilir (veya boşaltılır). Bu, potansiyelin artmasına (veya azalmasına) neden olur ve bunu kapasitörün dinlenme değerine doğru bir düşüş izler.

Her nöron-nöron bağlantısının, bu etkileşimin gücünü belirleyen skaler bir parametre olan kendine özgü bir ağırlığı vardır. Ağırlık, bağlantı türüne bağlı olarak dalgalanır. Bir nöronun potansiyeli belirli bir eşik değerinden daha yüksek olduğunda, nöronun kendisi bir çıkış dikeni üretir. Bu çıkış dikeni meydana geldikten sonra potansiyel eşiğin altında bir değere sıfırlanır. Bu tür bir modelde sivri uçlar yalnızca meydana geldikleri an ile tanımlanır; sivri uçlu bir nöron tarafından üretilen elektrik darbesinin gerçek şekli bu model içinde dikkate alınmaz.

Belirli bir giriş sinyali koleksiyonuna uygulandığında, toplu olarak amaçlanan ağ yanıtlarıyla, yani elektrik darbelerinin zamansal modelleriyle sonuçlanacak ağırlıkları bulmak, bir destek vektörü sinir ağını (SNN) eğitmenin ne anlama geldiğinin özüdür.

Bu sürecin bir örneği basit bir senaryoda görülebilir: ayarlanabilen bir ağırlıkla başka bir nörona bağlanan bir nöron, diğer nörondan girdi olarak tek bir diken alır (Şekil 1, sol).

Giriş spike’ı nöronun potansiyelinde hızlı bir artışa neden olur, bu da neredeyse kısa sürede eşiğe ulaşmasına ve bir çıkış spike’ına neden olur (Şekil 1, sağ).

Bunun nedeni, giriş sivri ucunun büyük bir pozitif ağırlıkla başlamasıdır.

Çıkıştaki bu artış, ağırlıktaki azalmanın bir sonucu olarak daha sonraki zamanlara itilir. Bununla birlikte, bir sorun vardır: ağırlık kabul edilemez bir seviyeye düşürülürse, potansiyel asla eşiğe ulaşmayacak ve bu da çıkış sivri ucunun aniden kaybolmasına neden olacaktır. Son örneğe benzer şekilde, ağırlık bir kez daha artırıldığında, çıkış ani yükselişi aniden ve sınırlı bir süre için ortaya çıkar. Çıkış sivri uçlarının bu süreksiz kayboluşu ve yeniden ortaya çıkışı ile sinir ağları için en yaygın olarak kullanılan eğitim yöntemlerinden bazıları olan hata geri yayılımı gibi gradyan tabanlı eğitim algoritmaları arasında temel bir uyumsuzluk vardır. Bu algoritmalar, bir nöronun ağırlıklarındaki sürekli değişikliklerin nöronun çıktısında sürekli değişikliklere yol açacağı varsayımıyla çalışır. Bu varsayım ihlal edilirse, bu yaklaşımlar SNN’lere uygulandığında eğitimi daha zor hale getirecek kararsızlıklara neden olacaktır. SNN’ler bu açmazın bir sonucu olarak önemli bir engelle karşı karşıya kalmıştır.

Klos ve Memmesheimer son araştırmalarında, SNN’lerde yukarıda bahsedilen süreklilik kriterini yerine getirmek için LIF modelinin sadece küçük bir değişikliğe ihtiyacı olduğunu keşfetmişlerdir. Bu modifikasyon, membran potansiyelinin kendisinde sivri uçların tipik yükselme-düşme şeklini içerir. Biyolojik nöronlarda ani yükselme olarak bilinen şey, nöronun membran potansiyelinde ani ve önemli bir artış ve azalmadır. LIF modeli ise bu tanımı sivri uç zamanlaması olarak basitleştirmektedir. Klos ve Memmesheimer, böyle bir artışı içeren bir nöron modeli araştırarak bu basitleştirmeyi aşmayı başardılar. Bu nöron modeli ikinci dereceden bütünleştir ve ateşle (QIF) nöronu olarak bilinir. Önemli bir fark dışında, bu model LIF modeliyle hemen hemen aynıdır. Membran potansiyelindeki artışları kendi kendine yükseltmeyi amaçlayan doğrusal olmayan bir terimin varlığının bir sonucu olarak, sonuçta sonlu bir sürede kararlı durumdan bir sapma ile sonuçlanır ve bu da ani yükselme olarak adlandırılır.

Sağdaki Şekil 1’de görülebileceği gibi, bu modeli kullanırken çıkış-çivrilme süresinin sürekli olarak hem ağırlıklara hem de giriş-çivrilme sürelerine bağlı olduğunu göstermektedirler. En önemli şey, giriş çok zayıf olduğunda sivri uç zamanlamasının aniden buharlaşmamasıdır; bunun yerine, kademeli olarak sonsuza ulaşana kadar kademeli olarak büyür.

Bir simülasyon araştırmacılar tarafından iki döneme ayrılmıştır. İlk dönem, girdilerin SNN’ye sunulduğu ve çıktıların SNN’den okunduğu bir deneme dönemidir. İkinci dönem, nöronal dinamiklerin devam ettiği, ancak çivilenmenin ek, sürekli artan bir giriş akımı ile kolaylaştırıldığı bir sonraki dönemdir. Bu, nöronların belirli bir hesaplama görevini çözmek için yeterince sık spike yapmasını sağlamak için yapılır. Sonuç olarak üretilen “sahte sivri uçlar” eğitim boyunca sürekli olarak deneme periyodunun içine ve dışına kaydırılabilir, bu da SNN’lerin sivri uç aktivitesini değiştirmek için kesintisiz bir mekanizma sağlar.

Mevcut sonuç, gradyan tabanlı yaklaşımlarla istikrarlı eğitimin mümkün olduğunu göstermekte ve SNN’lerin sahip olduğu son derece düşük güç tüketimi vaadini korurken SNN’ler ile YSA’lar arasındaki boşluğu önemli ölçüde kapatmaktadır. Bu sonuç, tam hata geri yayılımı olarak bilinen bir teknik kullanılarak SNN’lerin eğitilmesi üzerine yapılan önceki araştırmanın bir uzantısıdır. Daha spesifik olmak gerekirse, bu bulgular hem girdilere hem de ağ parametrelerine sürekli olarak bağlı olan çıkış sivri zamanlamalarına sahip yeni SNN mimarilerinin araştırılmasını teşvik etmektedir. Bu özellik, yakın tarihli bir teorik çalışmada da kritik bir adım olarak kabul edilmiştir. Öte yandan, çalışmalar sivri uçlarla sınırlı kalmayacaktır.

Yapay zekanın geleceği söz konusu olduğunda, ağ heterojenliği, plato potansiyelleri, diken patlamaları ve genişletilmiş sinir mimarileri gibi giderek daha karmaşık hale gelen biyolojik özelliklerin eklenmesinin neler getireceğini görmek beni heyecanlandırıyor.

Kaynak: physics.aps.org/articles/v18/5